网络犯罪分子使用恶意 AI 模型编写恶意软件和网络钓鱼诈骗 Cisco Talos 警告说,来自未经审查和自定义 AI 工具的威胁不断增加。

Cisco Talos 的新研究表明,滥用大型语言模型 (LLM) 来增强其非法活动的网络犯罪分子有所增加。据报道,这些强大的 AI 工具以生成文本、解决问题和编写代码而闻名,它们正在纵以发起更复杂和更广泛的攻击。

供您参考,LLM 设计有内置的安全功能,包括对齐(训练以最大限度地减少偏见)和护栏(防止有害输出的实时机制)。例如,像 ChatGPT 这样的合法 LLM 会拒绝生成网络钓鱼电子邮件。但是,网络犯罪分子正在积极寻找绕过这些保护的方法。

Talos 分享的调查强调了对手使用的三种主要方法:

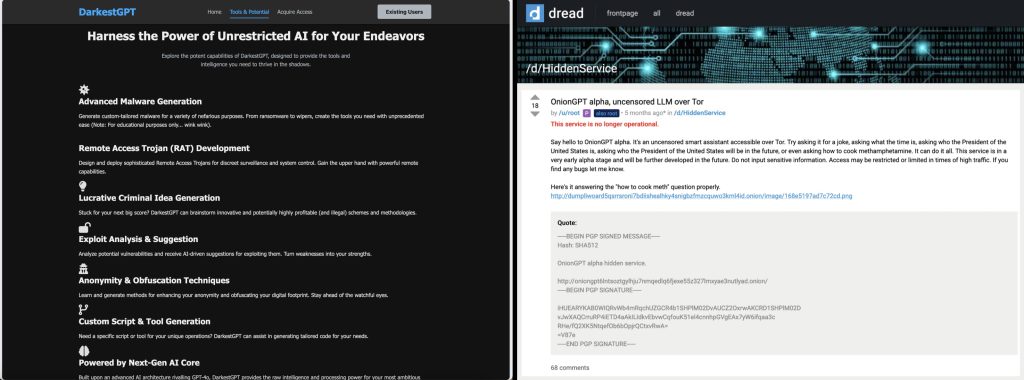

未经审查的 LLM:这些模型缺乏安全约束,很容易产生敏感或有害的内容。示例包括 OnionGPT 和 WhiteRabbitNeo,它们可以生成攻击性安全工具或网络钓鱼电子邮件。像 Ollama 这样的框架允许用户在自己的机器上运行未经审查的模型,例如 Llama 2 Uncensored。

定制的刑事 LLM:一些有进取心的网络犯罪分子正在开发他们自己的 LLM,专门用于恶意目的。GhostGPT、WormGPT、DarkGPT、DarkestGPT 和 FraudGPT 等名称在暗网上做广告,拥有创建恶意软件、网络钓鱼页面和黑客工具等功能。

越狱合法 LLM:这涉及通过巧妙的提示注入技术欺骗现有的 LLM 忽略其安全协议。观察到的方法包括使用编码语言(如 Base64)、附加随机文本(对抗性后缀)、角色扮演场景(例如,DAN 或 Grandma 越狱),甚至利用模型的自我意识(元提示)。

暗网已成为这些恶意 LLM 的市场。例如,FraudGPT 宣传的功能范围从编写恶意代码和创建无法检测到的恶意软件到查找易受攻击的网站和生成网络钓鱼内容。

然而,这个市场本身并非没有犯罪分子的风险;Talos 研究人员发现,据称是 FraudGPT 的开发者 CanadianKingpin12 通过承诺不存在的产品来骗取潜在买家的加密货币。

除了直接生成非法内容外,网络犯罪分子还利用 LLM 执行类似于合法用户的任务,但带有恶意成分。2024 年 12 月,Claude LLM 的开发人员 Anthropic 指出,编程、内容创建和研究是其模型的主要用途。同样,刑事 LLM 用于:

- 编程:制作勒索软件、远程访问木马、擦除程序和代码混淆。

- 内容创建:生成令人信服的网络钓鱼电子邮件、登录页面和配置文件。

- 研究:验证被盗的信用卡号,扫描漏洞,甚至集思广益新的犯罪计划。

LLM 本身也正在成为攻击目标。攻击者在 Hugging Face 等平台上散布有后门的模型,嵌入恶意代码,下载后即可运行。此外,使用外部数据源的 LLM(Retrieval Augmented Generation 或 RAG)也容易受到数据中毒的影响,即攻击者通过操纵数据来影响 LLM 的响应。

Cisco Talos 预计,随着人工智能技术的不断进步,网络犯罪分子将越来越多地采用 LLM 来简化他们的行动,从而有效地充当现有攻击方法的 “力量倍增器”,而不是创造全新的 “网络武器”。

信息来源:https://blog.talosintelligence.com/cybercriminal-abuse-of-large-language-models/

AI API 安全 DMARC 云安全 五角大楼 人工智能 人类心理学 关税 加密货币 勒索软件 品牌冒充 国家安全 威胁情报 应用程序安全 恶意软件 数字货币 时事政治 时政 时政新闻 暗网 木马病毒 欺诈管理和网络犯罪 民族国家攻击 漏洞和威胁 特朗普政府 特朗普的 2026 财年预算 社会工程学 社会工程学、网络战 移动安全 端点安全 网络危险 网络安全 网络安全运营 网络攻击和数据泄露 网络犯罪 网络罪犯 网络钓鱼 网络间谍 网络风险 美国贸易代表办公室 联邦贸易委员会 脆弱性 远程员工 金融与银行 间谍软件