网络安全研究人员披露了影响开源机器学习 (ML) 工具和框架(如 MLflow、H2O、PyTorch 和 MLeap)的多个安全漏洞,这些漏洞可能为代码执行铺平道路。

JFrog 发现的这些漏洞是这家供应链安全公司上个月首次披露的 22 个安全漏洞的一部分。

与涉及服务器端缺陷的第一组不同,新详细的允许利用 ML 客户端,并驻留在处理安全模型格式(如 Safetensors)的库中。

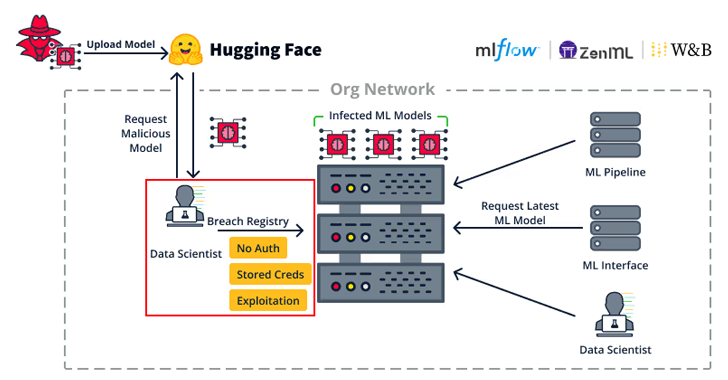

“劫持组织中的 ML 客户端可以让攻击者在组织内执行广泛的横向移动,”该公司表示。“ML 客户端很可能可以访问重要的 ML 服务,例如 ML Model Registry 或 MLOps Pipelines。”

反过来,这可能会暴露敏感信息,例如模型注册表凭证,从而有效地允许恶意行为者对存储的 ML 模型进行后门操作或实现代码执行。

漏洞列表如下 –

- CVE-2024-27132(CVSS 评分:7.2)- MLflow 中的清理不足问题,导致在 Jupyter Notebook 中运行不受信任的配方时发生跨站点脚本 (XSS) 攻击,最终导致客户端远程代码执行 (RCE)

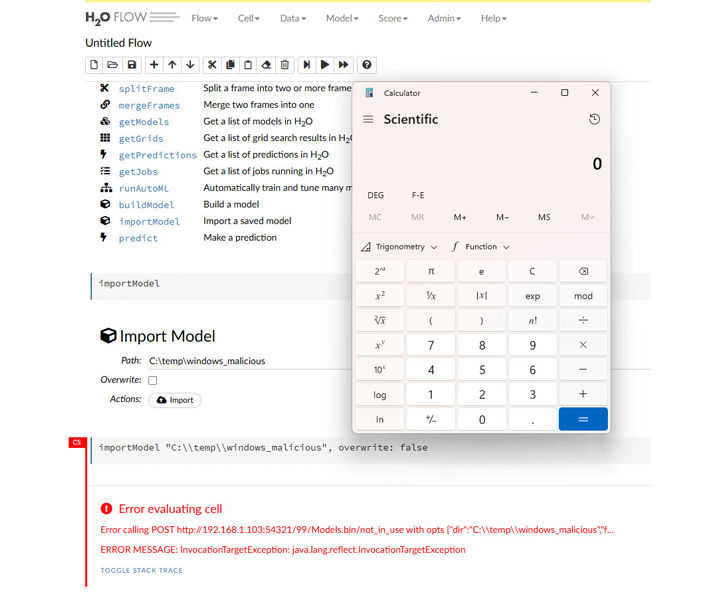

- CVE-2024-6960 (CVSS 分数:7.5) – 导入不受信任的 ML 模型时,H20 中存在不安全的反序列化问题,可能导致 RCE

- PyTorch 的 TorchScript 功能中存在路径遍历问题,由于任意文件覆盖,可能导致拒绝服务 (DoS) 或代码执行,然后可用于覆盖关键系统文件或合法的 pickle 文件(无 CVE 标识符)

- CVE-2023-5245 (CVSS 分数:7.5) – 以压缩格式加载已保存的模型时,MLeap 中的路径遍历问题可导致 Zip Slip 漏洞,从而导致任意文件覆盖和潜在的代码执行

JFrog 指出,即使 ML 模型是从安全类型(如 Safetensors)加载的,也不应盲目加载,因为它们具有实现任意代码执行的能力。

“人工智能和机器学习 (ML) 工具具有巨大的创新潜力,但也可能为攻击者打开大门,对任何组织造成广泛损害,”JFrog 的安全研究副总裁 Shachar Menashe 在一份声明中说。

“为了防范这些威胁,重要的是要知道您正在使用哪些模型,并且永远不要加载不受信任的 ML 模型,即使是从’安全’的 ML 存储库中也是如此。在某些情况下,这样做可能会导致远程代码执行,从而对您的组织造成广泛损害。

信息来源:https://thehackernews.com/2024/12/researchers-uncover-flaws-in-popular.html